Yakın bir zamanda yaptığım bir yanlış sonrası bazı sayfalarımın indexlenmeden kaldırıldığını farkettim. Robots.txt dosyası üzerinden yapmış olduğum bu hata sonrası insanın canını sıkan bir sürece götürebiliyor.

Buradaki süreçte yaptıklarımı sırasıyla sizinle paylaşıp yazıyı çok fazla uzatmak istemiyorum.

1 – Robots.txt dosyasında disallow: yaptığım kısmı kaldırdım.

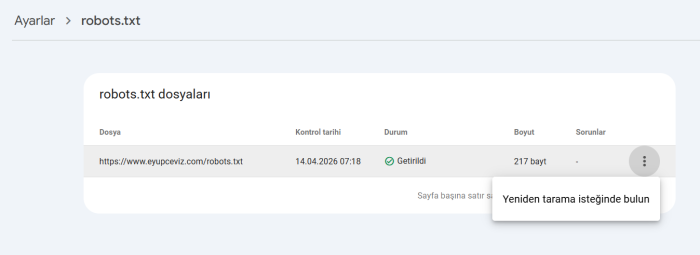

2 – Search Console kısmına girdikten sonra Ayarlar kısmına gelin Robots.txt karşısında raporu aç seçeneğine tıklayın. Aşağıdaki ekran görüntüsü gelecek üç noktaya tıklayıp yeniden tarama isteği tıklayın.

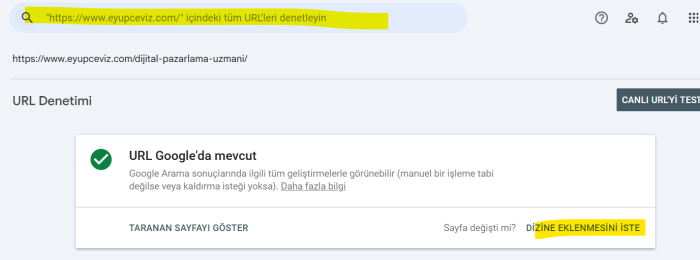

3 – Search console kısmına gelip dizin oluşturma altında sayfa sayısına tıklayın ve oradan robots.txt tarafından engellendi kısmını göreceksiniz orada hangi linkler burada engelledi orada göreceksiniz o linkleri alıp. Yukarıdaki kısma ekleyip enter tuşuna basın sonra aşağıdaki gibi bir ekran gelecek dizine eklenmesini iste kısmına tıklayın. Tüm etkilenen linkleri bu şekilde yapın.

4 – Search console kısmından Dizin oluşturma altında site haritaları kısmı var sizde sitemap olarakta olabilir ona gelin ve tekrar sitemap’i ekleyip gönder diyin.

5 – Yukarıdaki işlemleri yaptıktan sonra Search console kısmına gelip dizin oluşturma altında sayfa sayısına tıklayın ve oradan robots.txt tarafından engellendi kısmına tekrar gelin. Şuanki ekran görüntüsünde yok ama ayrıntıları göster yerine düzeltmeyi doğrula seçeneği çıkacaktır ona bastığında işlemi tamamlamış oluyorsunuz.

Bu işlemleri yaptıktan sonra bende bir gün sonra sayfaların geri sıralamaya geldiğini gördüm.

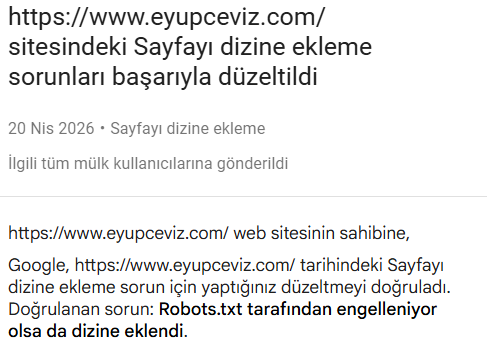

Sonrasında yine bildirim geliyor gerekli düzenlemeler başarıyla düzeltildi diye.